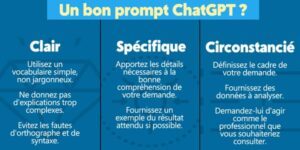

Les avancées en matière d’intelligence artificielle conduisent à l’émergence d’outils dits invisibles, capables de transformer le paysage numérique sans être détectés. Ces technologies promettent d’améliorer l’efficacité et la personnalisation dans divers domaines, de l’éducation à la cybersécurité. Pourtant, cette révolution suscite des interrogations quant aux risques éthiques et aux implications pour la vie privée. Certaines applications de ces outils pourraient subvertir la confiance en rendant impossible la distinction entre contenu généré par l’IA et celui produit par l’humain. Le défi consiste à exploiter ce potentiel tout en garantissant la transparence et la sécurité.

L’outil d’IA invisible représente une avancée significative dans le monde de la technologie, permettant de « humaniser » le contenu généré par l’IA pour échapper aux détecteurs d’intelligence artificielle. Ce phénomène engendre une série de questionnements, notamment en termes d’éthique et de potentiel abus. Bien qu’il puisse être utilisé pour encourager l’innovation dans des domaines créatifs ou expérimentaux, son usage dans des situations inappropriées, comme par les étudiants, soulève des inquiétudes. En somme, la démocratisation de cet outil met en lumière la nécessité d’un équilibre entre innovation et régulation.

Prenez contact pour discuter de votre projet

Apprenez comment ces compétences peuvent révolutionner votre expertise et dynamiser votre carrière. Saisissez cette occasion !

outil d’ia invisible : une technologie silencieuse

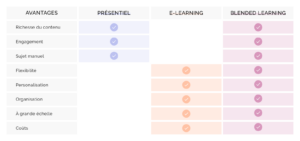

Les outils d’IA invisibles offrent un potentiel de transformation significatif pour plusieurs secteurs, mais ils ne sont pas sans controverse. Ils permettent une intégration discrète de l’intelligence artificielle dans des processus quotidiens, améliorant ainsi l’efficacité et réduisant les coûts. Par exemple, dans le domaine de la fabrication, ces outils peuvent optimiser les chaînes de production en temps réel sans intervention humaine. Cette harmonie avec l’existant est essentielle pour une adoption fluide, mais elle soulève également des questions de transparence et de contrôle.

les dangers potentiels de l’outil d’IA invisible

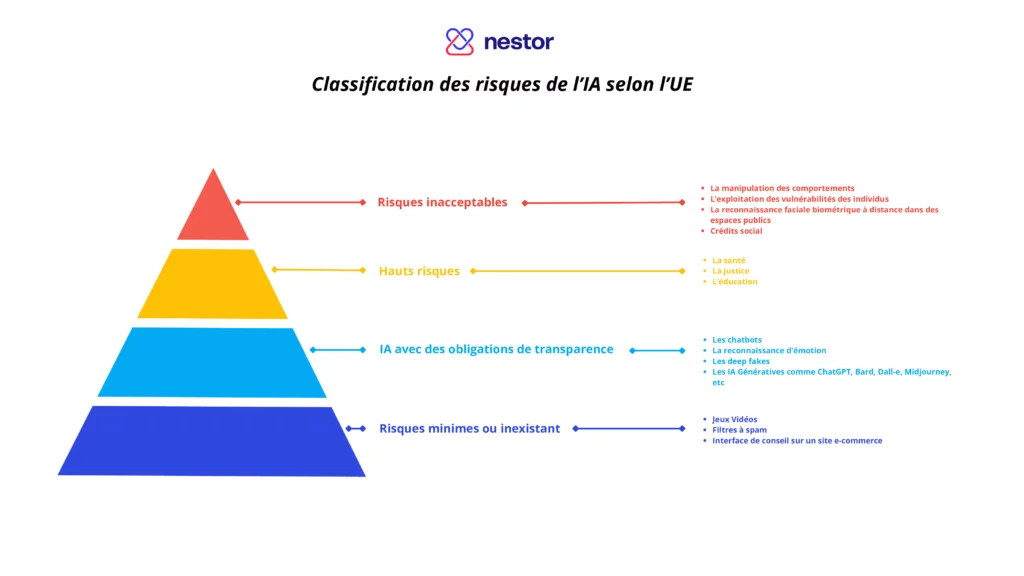

Alors que les outils d’IA se font de plus en plus omniprésents, les préoccupations concernant la sécurité et la vie privée augmentent. L’automatisation silencieuse signifie que l’analyse et le traitement des données peuvent se faire à notre insu, soulevant des inquiétudes quant à la sécurité des données personnelles. Des incidents récents ont démontré que ces innovations, aussi puissantes soient-elles, peuvent être détournées à des fins malveillantes ou pour des surveillances non sollicitées. L’équilibre entre l’efficacité promise et le risque de violation des droits fondamentaux reste une tension à gérer minutieusement.

l’intégration réussie des outils d’IA invisibles

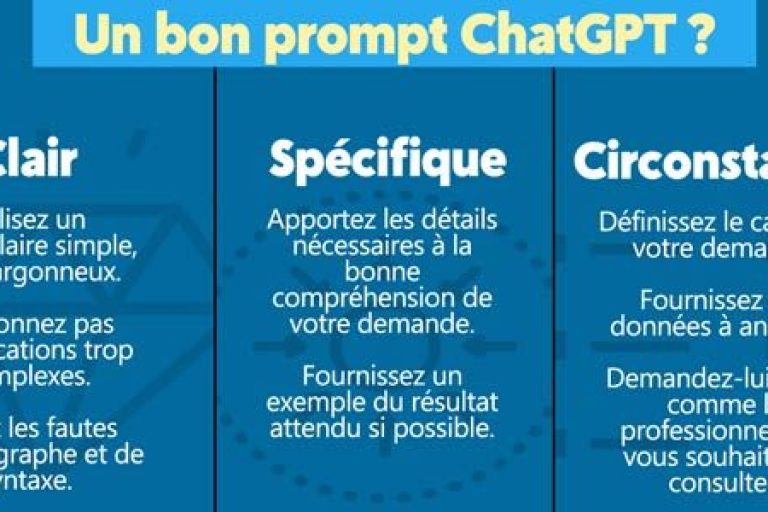

Pour exploiter pleinement le potentiel de ces outils sans tomber dans les pièges potentiels, il est crucial de mettre en place des cadres de gouvernance assurant la protection des utilisateurs. Cette question est particulièrement importante dans des secteurs comme le recrutement, où l’IA peut influer sur des décisions vitales. Une manière de minimiser les risques est de former en continu les développeurs et utilisateurs finaux aux meilleures pratiques en matière de sécurité. Ce mélange d’anticipation et de réactivité est ce qui permettra à l’IA invisible de ne pas devenir un calcul à risque pour les entreprises et les individus.

[#Article] 💰🤖 Levée de fonds historique de 6 milliards de dollars, facilité de crédit de 4 milliards : OpenAI conforte sa position de leaderhttps://t.co/qMOft8gUpv#IA #intelligenceartificielle

— Actu IA – Intelligence Artificielle (@ActuIAFr) October 5, 2024

Demandez Plus d'Informations

Découvrez comment ces nouvelles compétences peuvent transformer votre expertise et propulser votre carrière. Ne manquez pas cette chance !